Deducción de las fórmulas para la incertidumbre

De Laplace

(→Error estadístico) |

(→Extensión al caso de datos con diferentes errores) |

||

| Línea 116: | Línea 116: | ||

<center><math>S = \sum_i \frac{1}{E_i^2}\qquad S_x = \sum_i \frac{x_i}{E_i^2}</math></center> | <center><math>S = \sum_i \frac{1}{E_i^2}\qquad S_x = \sum_i \frac{x_i}{E_i^2}</math></center> | ||

| + | |||

| + | ==Error de una función== | ||

| + | Anteriormente establecimos que si teníamos una variable <math>x</math> cuya medida y error eran de la forma | ||

| + | |||

| + | <center><math>x = x_0 \pm E_x</math></center> | ||

| + | |||

| + | y queríamos calcular, a partir de ella, una función $y=f(x)$, | ||

| + | asignábamos como valor de la función a $y_0=f(x_0)$ y, como error, | ||

| + | \begin{equation} | ||

| + | E_y = \left|\frac{\mathrm{d}f}{\mathrm{d}x}\right| E_x | ||

| + | \end{equation} | ||

| + | Para explicar esta expresión partimos, de que, con un 95\% de | ||

| + | probabilidad $x$ está comprendida en el intervalo | ||

| + | \begin{equation} | ||

| + | x \in \left(x_0 - E_x, x_0 + E_x\right) | ||

| + | \end{equation} | ||

| + | Por tanto, $y=f(x)$ tendrá la misma probabilidad de encontrarse en el | ||

| + | intervalo | ||

| + | \begin{equation} | ||

| + | y= f(x)\in \left(f(x_0-E_x), f(x_0+E_x)\right) | ||

| + | \end{equation} | ||

| + | Sin embargo, como comentamos antes, no resulta una banda centrada en | ||

| + | $f(x_0)$ | ||

| + | \begin{center} | ||

| + | \figura{terror6} | ||

| + | \end{center} | ||

| + | En la mayoría de los casos, no obstante, se cumple que el error es una | ||

| + | cantidad pequeña y podemos hacer el desarrollo en serie de Taylor en | ||

| + | torno al punto $x_0$. En este caso, sí resulta una banda simétrica. | ||

| + | Aplicando esta función a los extremos del intervalo resulta | ||

| + | aproximadamente | ||

| + | \begin{equation} | ||

| + | f(x_0+E_x) \simeq f(x_0) + E_x \frac{\mathrm{d}f}{\mathrm{d}x}(x_0) + | ||

| + | \cdots | ||

| + | \qquad\qquad | ||

| + | f(x_0-E_x) \simeq f(x_0) - E_x \frac{\mathrm{d}f}{\mathrm{d}x}(x_0) + | ||

| + | \cdots | ||

| + | \end{equation} | ||

| + | siendo el punto medio del intervalo | ||

| + | \begin{equation} | ||

| + | y_0 = \frac{1}{2}\left(f(x_0+E_x)+f(x_0-E_x)\right) = f(x_0) | ||

| + | \end{equation} | ||

| + | y siendo el error la mitad de la distancia entre los extremos del | ||

| + | intervalo de $f(x)$ | ||

| + | \begin{equation} | ||

| + | E_y = \frac{1}{2}\left|f(x_0+E_x)-f(x_0-E_x)\right| = | ||

| + | \left|\frac{\mathrm{d}f}{\mathrm{d}x}\right| E_x | ||

| + | \end{equation} | ||

| + | que es la expresión que dimos antes. | ||

| + | |||

| + | Si ocurre que esta derivada es nula o el error es muy grande, habrá que | ||

| + | retener más términos en el desarrollo en serie de Taylor o recurrir a | ||

| + | la expresión original, admitiendo una barra de error asimétrica. | ||

[[Categoría:Prácticas de laboratorio]] | [[Categoría:Prácticas de laboratorio]] | ||

Revisión de 18:50 19 mar 2010

1 Error estadístico

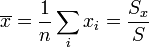

En otros artículos se enuncian las expresiones para, dado un conjunto de medidas xi de una misma magnitud x, establecer qué valor le asignamos a la medida y a su error como

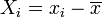

con  la variable relativa a la media.

la variable relativa a la media.

La justificación de estas fórmulas proviene de una hipótesis básica: que existe una cierta distribución para las distintas medidas.

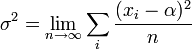

Supongamos que hiciéramos muchas medidas de esta magnitud y fuéramos clasificando los resultados según la frecuencia con que aparece cada valor. Cuando el número de medidas tiende a infinito obtenemos lo que se llama la función de distribución, p(x).

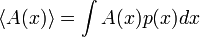

Esta función nos permite obtener la probabilidad de un resultado concreto, de un intervalo de valores, o la probabilidad para una variable A, función de x.

Dada la función de distribución de la variable x, p(x), el valor esperado (para entendernos, el promedio) de la variable A(x) viene dado por

que, en palabras, significa que el promedio de A no es más que la suma de todos los valores, teniendo en cuenta que algunos valores de x aparecen más a menudo que otros.

Las funciones de distribución, p(x), pueden ser de diferentes tipos, pero la más común es la llamada distribución gaussiana, con forma de campana, como la curva continua de la figura anterior.

Dada la función de distribución de una magnitud, dos son sus características principales:

- Media

- o esperanza. Equivale a la media aritmética de los resultados, cuando el número de medidas tiende a infinito. Para una distribución gaussiana, la media corresponde al valor de x para el máximo de la campana. Representaremos la media de la distribución como

- Varianza

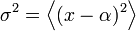

- Se define como

- y da una medida de la dispersión de los datos alrededor del valor medio, esto es, de la anchura de la distribución.

- Para ser más precisos, la raíz de la varianza se denomina la desviación cuadrática media, σ, y, para una distribución gaussiana, es igual a la mitad de la anchura de la campana, medida a una altura e − 1 / 2 = 0.61$ del máximo.

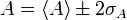

Para el caso de una distribución gaussiana, si tomamos una banda de anchura 2σ alrededor de la media, la probabilidad de que nuestras medidas queden dentro de este intervalo es de un 95.5%. Se entiende entonces que, adoptando el criterio del 95% para la banda de error, una muy buena aproximación para el error de una cierta cantidad es

Como criterio supondremos que, dado un conjunto de datos, que suponemos que sigue una cierta distribución de probabilidad, el valor “real” de la medida es la media de la distribución correspondiente.

El problema que surge es que la media de la distribución (y la desviación cuadrática media) sólo se conoce tras infinitas medidas, lo cual la hace inalcanzable.

Se trata entonces de, con un número finito de datos, hallar la mejor aproximación posible a la media.

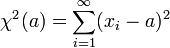

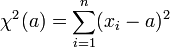

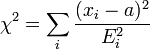

Una forma de obtenerla es mediante el método de mínimos cuadrados. Cuando se consideran infinitas medidas, se verifica que la cantidad

es mínima cuando a = α, esto es, para la media de la distribución. La idea es mantener esta expresión para un número finito de datos. La mejor estimación para la media de la distribución será aquel valor de a que haga mínima la cantidad

Podemos interpretar este resultado gráficamente. Supongamos que anotamos las diferentes medidas como alturas en una escala. Se trata de hallar un valor que sea la mejor aproximación a todos los datos. Para cada valor tomamos la diferencia entre la medida y este valor. Será una cierta cantidad, que podemos considerar el error de cada dato individual. Elevándola al cuadrado (para que sea siempre positiva) y sumando para todos los datos, el valor mínimo nos dará la mejor aproximación simultánea a todos los datos, aunque puede que no coincida con ninguna de las medidas.

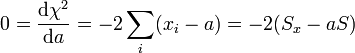

Aplicando la fórmula para el mínimo de una función tenemos

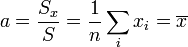

donde hemos separado los dos sumandos y sacado factor común. El valor óptimo será entonces

esto es, la media aritmética. Esto está en perfecto acuerdo con la idea de que la media de la distribución coincide con la media aritmética cuando el número de medidas tiende a infinito.

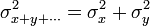

Para hallar el error de esta estimación, partimos de que si tenemos un conjunto de medidas independientes entre sí, se verifica que la varianza de la suma es la suma de las varianzas

por lo que

donde  es la varianza de la distribución de los datos, que también debemos estimar.

es la varianza de la distribución de los datos, que también debemos estimar.

Para hallar la aproximación a la varianza, puede hacerse un razonamiento similar al de la media, pero ligeramente más complicado. Sabemos que, en el límite de infinitas medidas, la varianza verifica

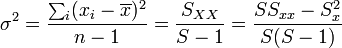

Si intentamos extender esta fórmula a un número finito de datos, debemos tener en cuenta que la propia media aritmética está sometida a error, de forma que la mejor aproximación a la varianza de los datos es

La razón de que aparezca n − 1 en lugar de n en el denominador se debe precisamente a que  es una aproximación a la verdadera media de la distribución y no coincide exactamente con ella.

es una aproximación a la verdadera media de la distribución y no coincide exactamente con ella.

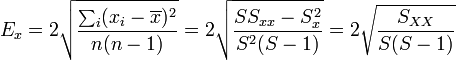

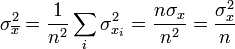

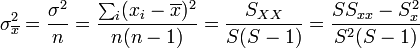

La estimación de la varianza de la media será entonces

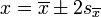

La aproximación a la desviación cuadrática media será la raíz de esta cantidad, por lo que la mejor aproximación a la magnitud y su error será

que es la expresión que aparece en el artículo correspondiente.

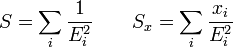

1.1 Extensión al caso de datos con diferentes errores

Las fórmulas anteriores presuponen que todas las medidas pertenecen a la misma distribución y por tanto están sujetas al mismo error. Sin embargo, puede ocurrir que tengamos una serie de datos con errores diferentes y aun así estemos interesados en hallar la mejor aproximación a la media.

En este caso, al método de mínimos cuadrados aun es aplicable, pero la función que debemos minimizar es

siendo Ei el error del dato i. La interpretación de esta modificación es simple: tenemos más en cuenta aquellos datos que tienen menos error, mientras que los que tienen un error más grande aportan una contribución pequeña al sumatorio.

En la figura,  representa la media que obtendríamos si consideramos todos los datos con el mismo error, mientras que

representa la media que obtendríamos si consideramos todos los datos con el mismo error, mientras que  sería el resultado si se tiene en cuenta que los valores superiores son más inciertos que los inferiores.

sería el resultado si se tiene en cuenta que los valores superiores son más inciertos que los inferiores.

La formula corregida para la media sigue siendo

pero donde ahora los sumatorios valen

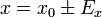

2 Error de una función

Anteriormente establecimos que si teníamos una variable x cuya medida y error eran de la forma

y queríamos calcular, a partir de ella, una función $y=f(x)$, asignábamos como valor de la función a $y_0=f(x_0)$ y, como error, \begin{equation} E_y = \left|\frac{\mathrm{d}f}{\mathrm{d}x}\right| E_x \end{equation} Para explicar esta expresión partimos, de que, con un 95\% de probabilidad $x$ está comprendida en el intervalo \begin{equation} x \in \left(x_0 - E_x, x_0 + E_x\right) \end{equation} Por tanto, $y=f(x)$ tendrá la misma probabilidad de encontrarse en el intervalo \begin{equation} y= f(x)\in \left(f(x_0-E_x), f(x_0+E_x)\right) \end{equation} Sin embargo, como comentamos antes, no resulta una banda centrada en $f(x_0)$ \begin{center} \figura{terror6} \end{center} En la mayoría de los casos, no obstante, se cumple que el error es una cantidad pequeña y podemos hacer el desarrollo en serie de Taylor en torno al punto $x_0$. En este caso, sí resulta una banda simétrica. Aplicando esta función a los extremos del intervalo resulta aproximadamente \begin{equation} f(x_0+E_x) \simeq f(x_0) + E_x \frac{\mathrm{d}f}{\mathrm{d}x}(x_0) + \cdots \qquad\qquad f(x_0-E_x) \simeq f(x_0) - E_x \frac{\mathrm{d}f}{\mathrm{d}x}(x_0) + \cdots \end{equation} siendo el punto medio del intervalo \begin{equation} y_0 = \frac{1}{2}\left(f(x_0+E_x)+f(x_0-E_x)\right) = f(x_0) \end{equation} y siendo el error la mitad de la distancia entre los extremos del intervalo de $f(x)$ \begin{equation} E_y = \frac{1}{2}\left|f(x_0+E_x)-f(x_0-E_x)\right| = \left|\frac{\mathrm{d}f}{\mathrm{d}x}\right| E_x \end{equation} que es la expresión que dimos antes.

Si ocurre que esta derivada es nula o el error es muy grande, habrá que retener más términos en el desarrollo en serie de Taylor o recurrir a la expresión original, admitiendo una barra de error asimétrica.